해외AI/DS소식

사용자 동의 없이 개인 정보 수집해 감시·통제하는 기업과 국가사용자의 심리적 약점을 파고들어 중독을 유발하고, 심지어 사회적 갈등을 조장하기도기술의 발전은 윤리적 책임과 개인의 자유를 존중하는 방식으로 진행돼야 [해외DS]는 해외 유수의 데이터 사이언스 전문지들에서 전하는 업계 전문가들의 의견을 담았습니다. 저희 글로벌AI협회 연구소(GIAI R&D)에서 콘텐츠 제휴가 진행 중입니다.

Read More

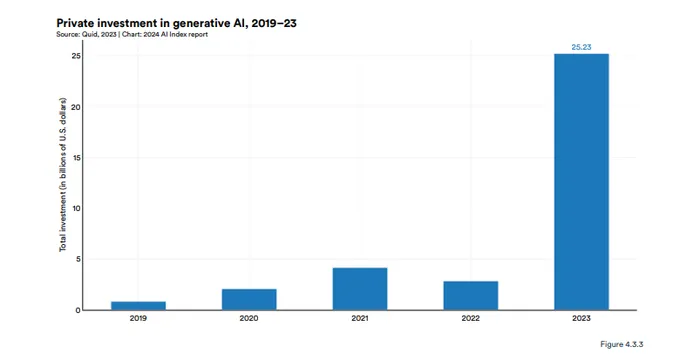

지난해 생성형 AI 252억 달러 유치, 기존과는 차원이 다른 투자 규모 기록해 주로 기반 모델 학습 비용 증가와 고성능 컴퓨팅 자원에 대한 수요 증가에 대응하기 위해 사용돼미국 주요 분야에서 압도적인 우위를 점하고 있지만, 중국 일부 영역에서 빠르게 추격하고 있어 미국 스탠퍼드대학의 인간중심 인공지능연구소(HAI) 2024 AI 인덱스 보고서에 의하면, 지난해 생성형 AI 기업들의 펀딩이 8배 증가하여, 총 252억 달러에 달했다고 한다. 오픈AI와 코히어 등 주요 AI 기업들이 대규모 투자 유치에 성공한 까닭이다. 작년의 주요 투자 사례로는 마이크로소프트의 100억 달러 규모의 오픈AI 계약, 코히어의 2억 7천만 달러 투자 유치, 미스트랄의 4억 1천5백만 달러 투자 유치 등이 있다. 또한 이 보고서에 따르면 2023년 전체 AI 관련 민간 투자의 4분의 1 이상을 생성형 AI가 차지한 것으로 나타났다.

Read More

이전에는 모든 것이 측정 가능하다고 생각했지만, 19세기 후반 측정 불가능한 양의 존재 발견측정 불가능한 양의 대표적인 예시는 바로 '비탈리 집합'물리적으로 극히 드물게 나타나지만, 수학의 기초를 바꾸지 않고서는 제거하기 어려워 [해외DS]는 해외 유수의 데이터 사이언스 전문지들에서 전하는 업계 전문가들의 의견을 담았습니다. 저희 글로벌 AI협회 연구소(GIAI R&D)에서 콘텐츠 제휴가 진행 중입니다.

Read More