[딥테크] AI 시대의 저널리즘, 신뢰는 인간의 이름으로 유지된다

입력

수정

독일 AI 제작 뉴스에 불신, 신뢰의 기준은 검증 가능성 허위정보 확산 속 인간 중심의 편집과 출처 공개가 핵심 EU 규제와 출처 기술, 저널리즘 신뢰의 새 틀 구축

본 기사는 스위스 인공지능연구소(SIAI)의 SIAI Business Review 시리즈 기고문을 한국 시장 상황에 맞춰 재구성한 글입니다. 본 시리즈는 최신 기술·경제·정책 이슈에 대해 연구자의 시각을 담아, 일반 독자들에게도 이해하기 쉽게 전달하는 것을 목표로 합니다. 기사에 담긴 견해는 집필자의 개인적 의견이며, SIAI 또는 그 소속 기관의 공식 입장과 일치하지 않을 수 있습니다.

독일에서 인공지능(AI)이 만든 뉴스에 대한 불신이 뚜렷하게 드러났다. 2025년 1월 실시된 조사에서 독일 인터넷 이용자의 54%가 AI가 주로 작성한 뉴스를 읽을 때 불편함을 느낀다고 답했다. 사람 편집자가 최종 검수를 거치더라도 신뢰 수준은 달라지지 않았다. 이러한 반응은 단순한 기술 거부감이 아니라, 정보의 진위를 구분하기 어려워진 환경에 대한 경계심을 보여준다. 독자들은 ‘검증 가능한 저널리즘’을 원하며, 뉴스 생산 과정에서 AI의 개입 정도를 추측하기를 원하지 않는다.

이 같은 흐름은 독일 일간지 쥐트도이체 차이퉁(Süddeutsche Zeitung)이 진행한 실험에서도 확인됐다. 신문사는 독자들이 AI와 인간이 만든 이미지를 얼마나 구별할 수 있는지를 알아보기 위해 수천 명의 구독자를 무작위로 나눴다. 한 집단에는 실제 사진과 AI 생성 이미지를 함께 제시하고 어느 쪽이 진짜인지 맞히도록 했으며, 다른 집단에는 실제 사진만 보여주고 일반적인 내용 질문을 던졌다.

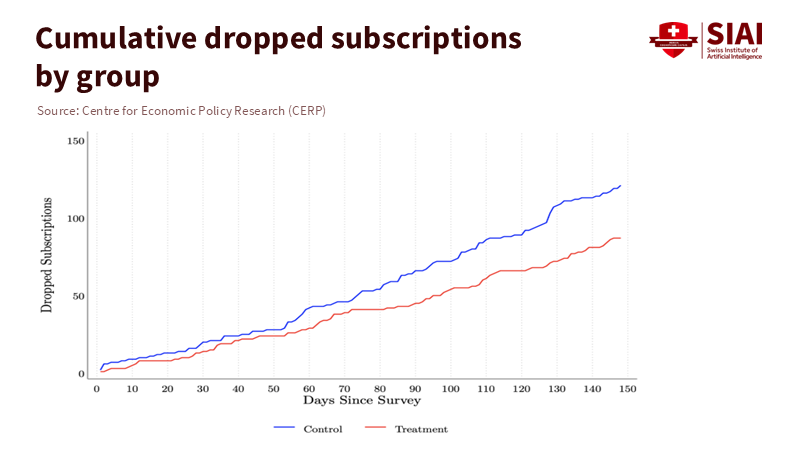

그 결과는 뚜렷했다. AI 이미지 구별 퀴즈에 참여한 독자들은 뉴스 소비 행태에 변화를 보였다. 실험 직후 사이트 방문 횟수가 평균 2.5% 늘었고, 이후 몇 달 동안 구독 유지율도 1.1%포인트 높았다. 허위 정보의 위험을 직접 체감한 독자일수록 검증된 매체로 더 자주, 더 오래 돌아간 것이다. 결국 변화를 이끈 것은 기술의 새로움이 아니라 신뢰였다. AI 시대의 뉴스 경쟁력은 투명한 출처 공개와 인간의 책임, 그리고 일관된 검증 체계에서 비롯된다.

AI 신뢰의 바탕, 독일 사회의 인식

독일 독자들은 언론 자동화에 대해 신뢰와 회의가 교차하는 태도를 보인다. 2025년 조사에서 온라인 인구의 45%가 “대부분의 뉴스는 믿을 수 있다”라고 답했으며, 공영방송과 지역 신문이 가장 높은 신뢰도를 기록했다. 그러나 응답자의 다수는 사람이 작성한 뉴스가 AI가 만든 뉴스보다 더 믿을 만하다고 평가했다. 이는 세대 차이나 기술 비관론이 아니라 책임에 대한 사회적 기준을 반영한다. 독자들은 ‘AI 제작 뉴스’에 부정확한 문장, 오류, 어색한 이미지, 책임 회피의 위험을 연상한다. 따라서 신뢰를 얻기 위해서는 모든 핵심 단계에 인간이 참여해야 하며, 그 과정이 명확히 드러나야 한다.

이 같은 인식은 근거 없는 우려가 아니다. 2024년 조사에서 독일 성인의 43%만이 “대부분의 뉴스는 신뢰할 수 있다”고 응답했으며, 이는 조사 이래 가장 낮은 수치였다. 또 42%는 “가짜 뉴스와 진짜 뉴스를 구분하기 어렵다”고 답했고, 25%는 이민이나 정치와 관련된 허위 정보를 접한 경험이 있다고 밝혔다. 이러한 현실에서 AI 뉴스에 대한 불편함은 자연스러운 결과다.

이러한 여론은 실제 실험에서도 그대로 드러났다. 참가자 다수는 AI가 생성한 이미지를 실제 사진으로 착각했지만, 동시에 인간이 만든 이미지를 더 사실적이고 신뢰할 수 있다고 평가했다. 사람들은 진짜와 가짜를 구별하지 못하면서도 ‘진짜’는 인간의 손에서 나온 결과물이라고 믿는다. 인식과 판단이 엇갈리는 이 모순이 정보 환경 전반의 불안을 키우고 있다. 진실을 검증하고 신뢰를 보증하는 책임은 결국 언론에 있다. 명확한 출처와 신호를 제공하는 것이 그 첫 단계다.

신뢰의 희소가치

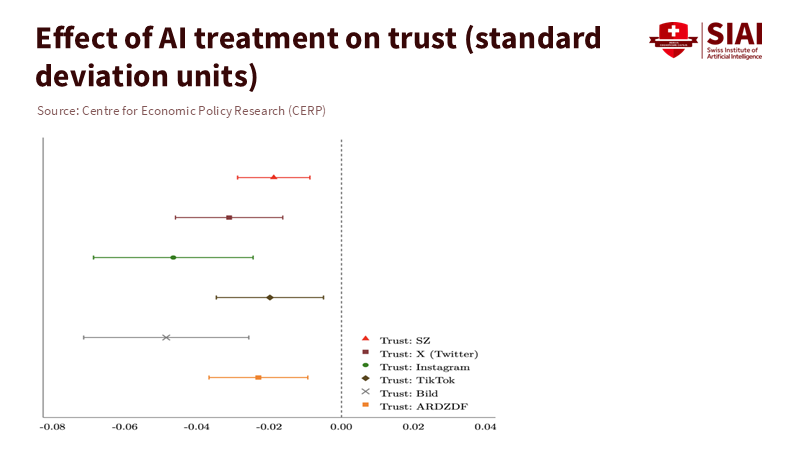

독일 일간지 쥐트도이체 차이퉁(Süddeutsche Zeitung)이 진행한 실험은 신뢰의 작동 방식을 구체적으로 보여준다. 독자들이 AI와 현실의 경계를 직접 경험했을 때, 여러 매체에 대한 전반적 신뢰는 낮아졌지만, 이미 신뢰하던 매체에 대한 이용과 구독 유지율은 오히려 높아졌다. 진짜처럼 보이는 가짜가 범람할수록 검증된 출처의 가치는 커진다. 이는 불안을 자극하는 전략이 아니라 신뢰가 형성되는 구조다. 투명한 절차와 명확한 책임, 오류에 대한 대응이 확보된 언론일수록 독자의 선택을 받는다. AI의 개입 범위와 최종 판단 주체를 분명히 밝히는 뉴스룸이야말로 신뢰를 얻는다.

주: 조사 경과일수(X축), 누적 구독 해지 건수(Y축)/비실험 집단(파란색), 실험 집단(빨간색)

이 원리는 특정 매체에 국한되지 않는다. 로이터 저널리즘 연구소 조사에 따르면, 정치·이민·전쟁 등 민감한 의제에서 독자들은 AI가 작성한 뉴스에 불안을 느끼며, 사람 중심의 제작 방식을 선호한다. 핵심은 도구의 사용 여부가 아니라 주제별로 명확한 기준을 세우는 일이다. 선거, 건강, 분쟁과 같은 주요 사안은 사람이 작성·편집해야 하며, AI가 개입할 경우 그 사실을 명시해야 한다. 반대로 스포츠나 날씨처럼 구조화된 정보는 표시를 전제로 자동화를 확대할 수 있다. 편집 과정의 투명성과 독자의 위험 인식이 일치할 때 신뢰는 유지되고, 이용은 신뢰할 수 있는 매체로 집중된다.

규제와 기술의 신뢰 구조

유럽연합(EU)은 인공지능(AI) 규제를 통해 뉴스 신뢰의 제도적 기반을 마련하고 있다. EU 인공지능법(AI Act)은 2024년 8월 1일 발효돼 2026년까지 단계적으로 시행된다. 2025년 2월부터는 허위 정보 생성, 감시 목적의 AI, 조작적 콘텐츠 활용 등이 금지되고, 언론과 교육기관에는 AI 활용 교육 의무가 부과된다. 같은 해 8월에는 범용 AI 모델에 대한 관리 규정이 추가로 시행된다. 핵심 조항인 50조는 AI가 만든 콘텐츠나 수정된 자료에 AI 개입 사실을 명확히 표시하도록 의무화했다. 이용자가 합성된 정보를 명확히 인지하도록 하기 위한 조치다.

독일도 같은 방향으로 움직이고 있다. 정부는 언론사에 AI 생성 이미지와 텍스트의 출처, 개입 정도를 공개하도록 권고하고 있으며, 각 언론사는 이를 내부에 기록해 검증 체계를 마련하고 있다. 이는 단순한 규제가 아니라, AI 활용의 투명성을 제도적으로 보장하고 인간의 최종 책임을 명확히 하는 조치다.

이 신뢰 구조를 기술적으로 뒷받침하는 것이 C2PA(Contents Provenance and Authenticity) 표준이다. 이 기술은 이미지, 영상, 음성 등 디지털 콘텐츠에 전자 서명 형태의 출처 정보를 남겨 제작자와 수정 이력을 확인할 수 있게 한다. 클라우드플레어는 이를 네트워크 전반에 적용하고 있으며, 어도비는 누구나 활용할 수 있는 인증 도구를 제공하고 있다. 구글 등 주요 플랫폼도 콘텐츠 출처 인증 시스템을 도입 중이다. 메타데이터는 삭제될 수 있지만, 워터마크 연동과 플랫폼 간 표준화가 확산되면서 신뢰의 기준선은 점차 높아지고 있다. 결국 AI 시대의 뉴스 신뢰는 ‘누가 만들었고, 어떻게 수정됐는지를 증명할 수 있는 체계’ 위에서만 유지된다. 출처 기술은 그 체계를 독자가 직접 확인할 수 있게 하는 장치다.

주: 표준편차(X축), 신뢰도(Y축)/독일 일간지(SZ), 트위터(X), 인스타그램(Instagram), 틱톡(TikTok), 독일 대중지(Bild), 독일 공영방송(ARDZDF)

신뢰를 다시 세우는 조건

AI가 만든 뉴스에 대한 불안이 커지는 가운데, 독일 사회는 그 속에서 신뢰의 기준을 새롭게 정립하고 있다. 허위 정보가 확산되는 시대일수록 독자들은 검증 가능한 언론을 찾고, 그 가치를 지키는 매체에 머문다. 불확실성이 커질수록 신뢰의 중요성은 커지고, 투명한 절차와 책임 있는 판단이 그 신뢰를 지탱한다.

앞으로의 과제는 분명하다. 민주주의의 핵심 의제는 사람이 책임지고 다루며, AI의 개입은 명확히 밝혀야 한다. 뉴스의 생산부터 유통까지 출처가 유지돼야 하고, 모든 편집 과정은 검증 가능해야 한다. EU의 관련 규정은 단순한 행정 의무가 아니라, 신뢰를 구축하는 산업 표준으로 자리 잡아야 한다. AI 시대의 저널리즘은 과거로의 회귀가 아니라 새로운 책임의 체계다. 신뢰는 원칙으로 세워지고 행동으로 유지된다. 투명한 표시 하나, 편집의 결정 하나가 모여 독자가 다시 안심하고 뉴스를 읽을 수 있는 환경을 만든다.

본 연구 기사의 원문은 AI Trust in News: Germany’s Path to Credibility in the Synthetic Era를 참고해 주시기 바랍니다. 본 기사의 저작권은 스위스 인공지능연구소(SIAI)에 있습니다.

- Previous [딥테크] 이제 숫자로 된 ‘경력’은 필요 없다

- Next 블록체인 지갑 기업 '해치랩스', 120억 시리즈A 투자 유치