바이비트 해킹으로 혼란 휩싸인 암호화폐 시장, 이더리움 '상장폐지설'까지

바이비트 해킹으로 혼란 휩싸인 암호화폐 시장, 이더리움 '상장폐지설'까지

입력

수정

이더리움, 바이비트 해킹 사태 이후 시장 신뢰 상실 주요 암호화폐부터 파생 상품까지 전반적으로 하락세 "규제도 무서운데" 겹악재에 韓 투자자 한숨 깊어져

암호화폐 거래소 바이비트(Bybit)의 해킹 사건으로 인해 시장이 혼란에 휩싸인 가운데, 해킹 피해가 발생한 알트코인(비트코인 이외의 후발 암호화폐) '이더리움'에 대한 비판적 의견이 거세지고 있다. 일각에서는 이더리움이 시장 신뢰를 잃으며 일부 거래소에서 상장폐지될 수 있다는 전망도 제기된다.

카르다노 창시자 "이더리움 몰락할 것"

25일 암호화폐업계에 따르면, 3세대 암호화폐 카르다노(Cardano, ADA)의 창시자 찰스 호스킨슨은 최근 벌어진 바이비트의 14억6,000만 달러(약 2조1,000억원) 규모 해킹 사건과 관련해 이더리움에 대한 비판적 의견을 드러냈다. 이번 해킹 피해는 이더리움과 이더리움 파생 상품에서 발생한 것으로 알려졌다.

호스킨슨은 비트멕스 창업자 아서 헤이즈가 "이더리움 블록체인의 롤백을 통해 해킹 피해를 되돌려야 한다"고 주장하자 "이더리움 클래식"이라는 짧은 답변을 남겼다. 이는 2016년 DAO 해킹 사태 당시 이더리움이 블록체인 롤백을 통해 ETC(이더리움 클래식)로 분리됐던 과거를 조롱한 것으로 풀이된다.

이어 그는 "이더리움은 ‘폐기된 인터넷 플랫폼’의 길을 가고 있으며, 이번 해킹 사태는 이더리움의 구조적 문제를 그대로 드러낸 사건"이라고 지적했다. 그는 이전에도 "이더리움의 현재 방향은 결국 마이스페이스(MySpace)나 넷스케이프(Netscape)처럼 몰락하는 길"이라며 "결국 이더리움 프로젝트들이 더 효율적이고 확장 가능한 카르다노로 이주할 가능성이 크다"고 지적한 바 있다.

그의 지적대로 바이비트 해킹 사건 이후 시장은 이더리움으로부터 속속 등을 돌리고 있다. 막대한 피해로 인해 보안 취약성 논란이 부각된 결과다. 글로벌 암호화폐 미디어 유투데이는 "이더리움이 신뢰를 잃고 있으며, 일부 거래소에서 상장폐지를 고려할 가능성이 있다"고 보도하기도 했다.

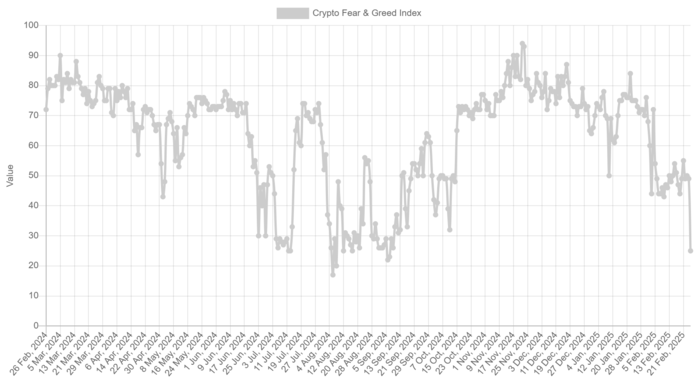

주요 암호화폐 가격 미끄러져

바이비트 해킹 사태는 이더리움을 넘어 암호화폐 시장 전반에 충격을 안겼다. 암호화폐 데이터 제공 업체 얼터너티브에 따르면 비트코인에 대한 공포·탐욕 지수(Fear and Greed Index)는 25를 기록하며 ‘극단적 공포’ 구간에 진입했다. 비트코인 공포·탐욕 지수가 극단적 공포 수준까지 하락한 것은 지난해 9월 7일 이후 약 6개월 만이다. 암호화폐 공포·탐욕 지수는 암호화폐 시장의 '심리 상태'를 수치화(0~100)한 지표로, 수치가 낮을수록 투자자들의 심리가 부정적이라고 해석한다.

투자 심리가 냉각되고 매물이 쏟아져 나오면서 주요 암호화폐들의 가격도 줄줄이 미끄러지는 추세다. 글로벌 코인 시황 중계 사이트 코인마켓캡에 따르면 25일 오전 9시 기준 비트코인은 4.82% 하락한 9만1,626.47달러(약 1억3,200만원)에 거래됐다. 이더리움은 2,518.79달러로 10.68% 하락했으며, XRP는 11.61% 급락한 2.27달러를 기록했다. 최근 지속적으로 약세를 보였던 솔라나는 16.11% 급락한 140.84달러에 거래됐다.

주요 암호화폐 가격이 일제히 하락하자 파생상품 시장도 함께 흔들렸다. 온체인 데이터 플랫폼 코인글라스에 따르면 24일 오전 9시부터 25일 오전 9시까지 집계된 암호화폐 시장 내 롱 포지션(미래에 더 높은 가격으로 되팔 수 있다는 기대를 가지고 매입하는 시장 거래) 청산 규모는 총 8억1,307만 달러(약 1조1,640억원)에 달한다.

국내 암호화폐 투자자 '비명'

암호화폐 시장이 휘청이는 가운데, 국내 투자자들의 한숨도 깊어지고 있다. 정부 차원의 암호화폐 규제 강화가 예고된 상황 속에 바이비트 해킹 사태라는 악재가 겹쳤기 때문이다.

앞서 지난달 금융위원회는 정부서울청사에서 제2차 가상자산위원회 회의를 열고 가상자산 이용자 보호 등에 관한 법률(가상자산이용자보호법) 2단계 입법의 주요 과제와 향후 검토 방향을 점검했다. 회의에서는 암호화폐 상장 기준과 절차를 금융당국 규제로 관리하고, 암호화폐 시장에 자본시장 공시에 준하는 공시 제도를 도입하는 방안이 유력하게 거론됐다. 밈 코인(인터넷과 SNS의 이미지나 유행어에서 영감을 받은 암호화폐)과 같은 부실 암호화폐의 가격 급등락으로 인해 이용자 피해가 커지고 있다는 판단에서다. 해당 규제가 현실화할 경우, 향후 규제 수준을 맞추지 못하는 암호화폐 발행사는 국내 상장에 난항을 겪을 가능성이 크다. 이미 상장된 코인에 대한 규제는 유예 기간을 두고 순차적으로 적용될 것으로 전망된다.

이에 더해 가상자산위원회는 스테이블 코인에 대한 규제도 별도로 마련하기로 했다. 국내 스테이블 코인 발행사에 준비 자산에 대한 엄격한 관리 의무를 부과해 스테이블 코인의 신뢰성을 담보하겠다는 구상이다. 스테이블코인 이용자의 상환청구권을 명시적으로 보장하는 방안도 유력하게 거론되고 있다. 금융위는 가상자산위원회 논의를 거쳐 올해 하반기 중에 가상자산보호법 2단계 입법안을 마련할 계획이다. 이와 관련해 김소영 금융위 부위원장은 "사업자·시장·이용자를 아우르는 종합적이고 체계적인 접근이 필요하다"며 "이른 시일 내 후속 절차를 추진하겠다"고 말했다.